Juan Dueñas aporta su granito de arena a la mejora de los sistemas de “traducción” de pensamientos

La capacidad de poder escribir utilizando únicamente la vista cada vez está más cerca gracias a la optimización de las Interfaces Cerebro-Ordenador (BCI, por sus siglas en inglés). En estos sistemas informáticos se centra el TFG de Juan Dueñas galardonado recientemente con el segundo premio en la categoría de TFG de los Premios ‘Valladolid, Ciudad Inteligente y Climáticamente Neutra’. El egresado del Campus de la UVa en Segovia ha desarrollado un sistema de “escritura visual” que alcanza una precisión del 95% y unos con tiempos de selección de 1.8 segundos por letra.

Un Brain-Computer Interface es un sistema informático que establece una comunicación directa entre el cerebro y un ordenador. Estos sistemas interpretan la actividad eléctrica producida por las neuronas al comunicarse entre sí, la procesan y la decodifican en comandos que se envían a un ordenador que se encarga de ejecutar la acción deseada: en este caso seleccionar una letra. Dueñas en su Trabajo Fin de Grado, titulado ‘Potenciando la extracción de características en sistemas brain-computer interface basados en c-VEP mediante TRCA’, ha desarrollado una versión optimizada de estos sistemas: “Hemos desarrollado un sistema de comunicación cerebro-ordenador más rápido y preciso, y que además necesita menos tiempo de calibración que otras soluciones anteriores. Además, hemos comparado por primera vez en un entorno práctico dos aproximaciones técnicas diferentes (códigos Gold y secuencias-m con desplazamiento circular) combinadas con dos métodos de procesado de señal (CCA y TRCA), lo que nos ha permitido identificar cuál funciona mejor en cada caso”, explica el egresado del Campus de la UVa en Segovia.

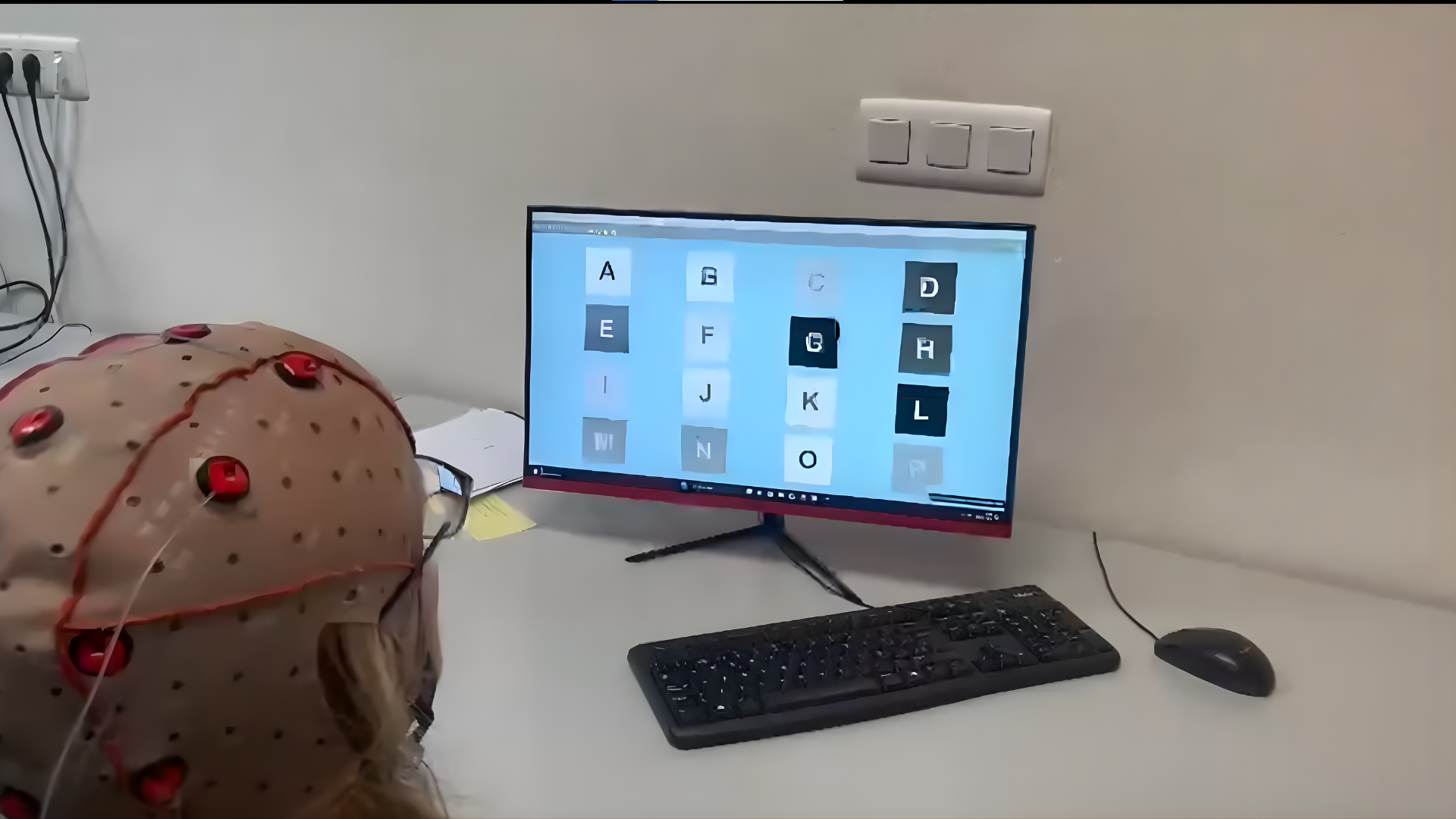

Gracias a un ‘casco’ repleto de electrodos, denominado técnicamente gorro de electroencefalograma, el sistema es capaz de detectar la respuesta del cerebro ante estímulos visuales diferentes. “Imagina que estás en una habitación a oscuras con varias linternas que parpadean a tu alrededor. Cada linterna tiene un patrón de parpadeo único: una puede hacer "corto-corto-largo-corto", otra "largo-corto-largo-largo”… De forma inconsciente, el cerebro reacciona de manera diferente al patrón de cada linterna. Es una respuesta automática, involuntaria. Siguiendo esta lógica, en mi trabajo, en vez de utilizar linternas, hemos utilizado elementos [letras] en una pantalla de ordenador que parpadean siguiendo diferentes patrones”. Las señales cVEP (potenciales evocados visuales modulados por código) utilizadas por Dueñas y el equipo del Grupo de Ingeniería Biomédica (GIB-UVa) en su trabajo son las respuestas cerebrales únicas que genera el cerebro ante cada patrón de parpadeo de los elementos de la pantalla. “Lo interesante es que podemos capturar las respuestas mediante electrodos en la cabeza y usarlas para saber qué está mirando la persona. Si asociamos cada patrón de parpadeo a una letra, número o comando, podemos construir un "teclado mental" donde solo tienes que mirar lo que quieres seleccionar”, explica Juan.

Para la creación de este BCI optimizado Juan Dueñas, guiado por sus tutores Víctor Martínez Cagigal y Aníbal Bregón Bregón, ha realizado un trabajo que podría dividirse en cuatro fases. En la primera de ellas estudió el comportamiento de las señales cerebrales cuando una persona mira elementos que parpadean siguiendo patrones específicos. Después, en una segunda etapa, desarrolló un software, similar al de un videojuego, capaz de mostrar elementos parpadeantes y otro programa capaz de capturar la señal del ‘casco’, limpiarla y analizarla para identificar el elemento que está mirando el usuario. En un paso posterior, implementó algoritmos matemáticos que extraen las "firmas cerebrales" características de cada patrón visual.

El último paso fue la experimentación y testeo del BCI. Para asegurar el correcto funcionamiento, validaron el sistema con datos de estudios anteriores. “Después seleccionamos 10 voluntarios sanos en condiciones reales a los que colocamos el gorro de electroencefalograma y con los que testamos el BCI. El resultado es un sistema donde la persona simplemente tienen que mirar la opción que quiere seleccionar en la pantalla, y el ordenador interpreta la actividad cerebral para ejecutar esa selección, sin necesidad de mover un dedo, pulsar un botón o hablar”.

El experimento constó de dos fases: una fase de calibración (unos 3-4 minutos) en la que el sistema "aprende" las respuestas cerebrales particulares de cada persona y una fase de test (unos 8-10 minutos) en la que ya funcionaba en tiempo real. “Se le pedía al participante que seleccionara elementos específicos (por ejemplo, "selecciona la letra M") simplemente mirándolos. El sistema procesaba la señal EEG y predecía qué estaba mirando, mostrando el resultado inmediatamente en pantalla. Todo estaba aleatorizado para evitar sesgos, y al final cada participante rellenaba un cuestionario sobre su experiencia: comodidad, facilidad de uso, fatiga visual…”, explica el egresado. Los resultados del testeo han sido muy positivos: se ha alcanzado una precisión media del 95-96% con tiempos de selección de aproximadamente 1.8 segundos por comando. Además, los participantes reportaron que el sistema era intuitivo y poco cansado de usar.

El trabajo desarrollado en base a la tecnología previa del Grupo de Ingeniería Biomédica de la UVa pone el foco en las personas y en la aplicación de los desarrollos tecnológicos con propósitos humanos. “No estamos hablando de gadgets o aplicaciones de entretenimiento, sino de herramientas que, en un futuro, podrán devolver autonomía e independencia a personas que la han perdido. Más allá del impacto individual, estos sistemas podrían tener un valor social enorme. Trabajar en este proyecto me ha hecho consciente de la responsabilidad que tenemos como ingenieros e investigadores: no basta con conseguir buenos resultados numéricos. Hay que preguntarse constantemente: ¿esto va a ayudar a alguien? ¿Podemos hacerlo más accesible, más barato, más fácil de usar?”, valora Dueñas.

Este Trabajo Fin de Grado ha sido reconocido en la convocatoria de premios ‘Valladolid, Ciudad Inteligente y Climáticamente Neutra’ ya que su impacto podría hipotéticamente, integrarse en infraestructuras municipales: quioscos de información accesibles, sistemas de domótica en residencias de mayores, herramientas de teleasistencia... “Me produce especial satisfacción que este trabajo se reconozca y no se quede en un cajón: el código es reutilizable, el sistema es funcional, y tiene potencial real para convertirse en un proyecto piloto en hospitales o centros asistenciales de Valladolid. Eso es lo que da sentido a la investigación: cuando sale del laboratorio y llega a las personas que realmente la necesitan”.